先日、LINEのClova WAVEとGoogleのGoogle Homeが発売され大きく話題になりました。年内にはAmazonのAlexaが販売開始予定で、追ってAppleもHomePodを投入予定です。加熱するAIスピーカーはスマホに続く新たなデバイスとして注目を集めています。

そんなわけで我が家にもClova WAVEとGoogle Homeがやってきました。実はClovaはデベロッパー向けの先行版を購入していたのですが、AIスピーカーとしての機能はほとんど使うことなく、ただのワイヤレススピーカーとしての役目しか果たしていません涙。続いてやってきたGoogle Homeはデベロッパー向けに公開されているものがあるので、さっそく色々と試して新しいアプリが作れないか模索しているところです。

現段階ではAIスピーカーで何が出来るのかキャッチアップしているところで何か成果物が出来ているわけではありませんが、AIスピーカーを使ったサービスを作るには何が必要なのか少しずつ見えてきたので書き留めておきたいと思います。

目次

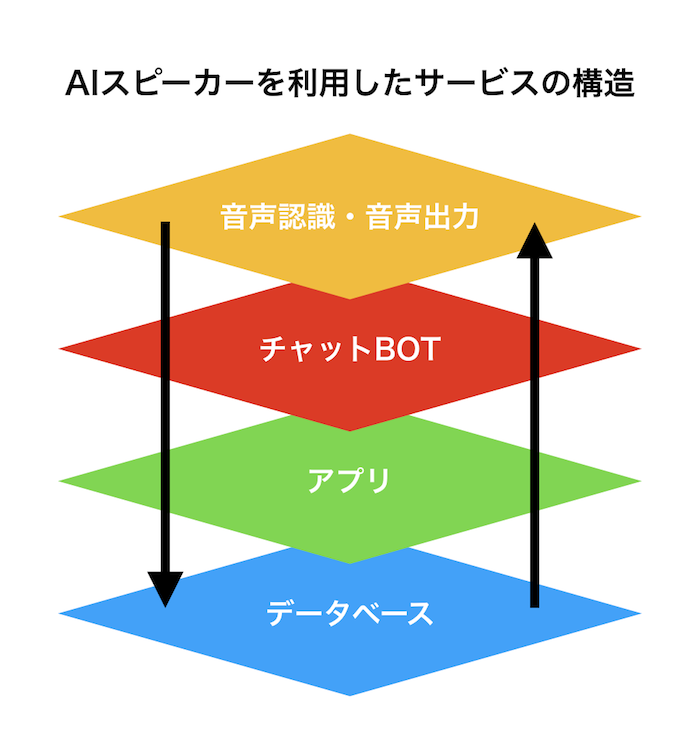

AIスピーカーを使ったサービスを分解してみる

AIスピーカーを使ったサービスは4つのレイヤーに分けられます。

- 音声認識と音声出力

- チャットBOT

- アプリ

- データベース

この4つのレイヤーがそれぞれの役割を果たして情報をやりとりすることでサービスが成立します。さらにこの縦構造に、アプリ間連携が加わるとより広がりのあるサービスが提供できます。

AIスピーカーで出来ること

AIスピーカーで出来ることをユーザーがしゃべりかけるところを起点に時系列で追ってみます。

- ユーザーが何かしゃべってリクエストをする

- スピーカーが音声認識してテキストを作成、それをチャットBOTに伝える

- チャットBOTはテキストの内容を読み取ってリクエスト先となるアプリを探し、命令を投げる

- アプリは受け取った命令を元にデータベースから必要な情報を引っ張ってくる

- アプリから返って来た回答をチャットBOTが受け取る

- チャットBOTが受け取った情報を元にセリフを作成し、音声出力する

AIスピーカーのサービスで私達が作る部分

上記の中で、音声認識と音声出力およびチャットBOTの部分はプラットフォーム側がほとんど用意してくれています。

なのでAIスピーカーを使ったサービスを作りたい場合はアプリとデータベースを利用して、どんな価値をユーザーに提供できるかに注力することになります。

- 音声認識や音声出力の部分は作らない

- チャットBOTの部分も作らない

- アプリとデータベースをどうするかが重要

(※AIスピーカー自体を作りたい場合は別です)

音声認識や音声出力に最適なアプリは何か?

Googleが提供しているGoogleアシスタントの開発ツールActions on GoogleのGET STARTEDでは会話インターフェースのユースケースを提示しています。

・人々がパッと思いついて答えることができること。 時間や日付のような使い慣れた入力で達成できるアクション。

・迅速に、しかし説得力のある有益な行為。 これらは、通常、商品をすばやく注文するなど、ごくわずかな時間で多くのメリットをユーザに提供します。

・本質的に声に適したアクション。 これらは、通常、料理中にレシピを聞くことや、運転中に記憶に留めるなど、ハンズフリーでやりたいことです。

日本語訳引用元: Actions on Googleの「GET STARTED – Basics」の日本語訳を作ってみました

スマホのように移動中のスキマ時間に利用したり、デスクトップPCのように仕事のときに座ってじっと眺めながら利用するのとは、まるでユースケースが違います。

カスタマージャーニーとイシューの発見

音声認識・出力に必要なサービスは、生活のほんの隙間、何かをしながら…というところにニーズがありそうです。

最近のWebサービスやアプリの開発では「カスタマージャーニーマップ」という手法がかなり広まってきました。音声認識・出力のサービスづくりにはこのカスタマージャーニーの作成が欠かせなくなってくるでしょう。ユーザーの行動をよく観察し、カスタマージャーニーを作成してイシューを発見する。そしてそのイシューは果たして音声認識と出力で解決可能なのか、適した回答をユーザーに提供できているのか、繰り返し検証することで良いサービスが作れそうです。

アプリの名前について

AIスピーカーを作ったサービスを作る際、ネーミングが非常に重要になります。なぜなら「○○○(サービス名)聞かせて」「○○○(サービス名)と話したい」というようなリクエストがどのプラットフォームでも必要になりそうだからです。聞き取りづらい、言いづらいネーミングはサービスの命取りになりそうです。

スピーカーだけで完結するアプリは多分死ぬ

スマホのOS標準で用意されているようなアプリ(時計・カレンダー・ボイスメモ・電話帳・音楽とか)では、恐らくGoogleやLINEが標準アプリとして用意してしまうのでよっぽどの工夫がないと生き残れないでしょう。

標準アプリにはない、スマホアプリと連携したマルチデバイスなアプリの中のひとつとして考えたほうが良さそうです。

例えば…

- スマホのアプリで好きな料理をお気に入り登録する

- 仕事帰りにおすすめのメニューと食材がスマホに通知される

- スーパーで食材を購入

- 自宅でAIスピーカーが手順を教えてくれながら調理

- 焼き時間や煮込む時間などAIスピーカーがタイマーの役割に

- 食事を始めると料理や時間帯に合った音楽が流れ始める

みたいな感じで、デバイスをまたがって生活の一部分に溶け込むような体験を生み出す必要があります。

本当にUXデザインの力が試されるのはこれから

AIスピーカーの登場で、いよいよ本格的に画面ではなく体験のデザインをしなければならない時代がやってきたような気がします。このような体験を生み出すことができるデザインツールは筆者が知る限り存在しません。UIデザインの制作フローが確立する中でSketchや数々のプロトタイピングツールが生まれたように、もしかしたらイケてる体験デザインツールが生まれてくるのかもしれないですね(誰か作ってるかも

Actions on GoogleとDialogflow

とりあえず、AIスピーカーなんか面白そうだなーと思った人は、Actions on GoogleとDialogflow(旧API.AI)触ることをオススメします。この2つを使えばコーディングいらずで自然言語処理・会話処理をGoogle Assistant上で実現できます。Google Homeがなくても、そしてスマホがなくても、PCブラウザ上でシミュレーターがあるので、そこで動くものを試すことができます。しかも完全無料です。

この記事がとても参考になりました。API.AIはDialogflowの旧称です。

もうちょっといろいろ触って、今後は簡単なアプリの作り方などを紹介していきたいと思います。

|

書き手:小島 芳樹 Webやスマートフォンアプリによるサービスを開発・提供する会社で働いています。 Twitter: @yoshikikoji |

この記事が気に入ったらいいね・フォローお願いします!

Backlogのデザインが大幅リニューアル!画面遷移の少ない、より快適なインターフェースへ

Backlogのデザインが大幅リニューアル!画面遷移の少ない、より快適なインターフェースへ 旅先の相談がすぐできる!お手軽チャットアプリ「KINPEN」使ってみた。

旅先の相談がすぐできる!お手軽チャットアプリ「KINPEN」使ってみた。 音楽はもっとシェアする時代へ。プレイリスト共有サービス「DIGLE」を使ってみた。

音楽はもっとシェアする時代へ。プレイリスト共有サービス「DIGLE」を使ってみた。 綺麗なグラフを簡単に作成・シェアできるサイト「Chartify」

綺麗なグラフを簡単に作成・シェアできるサイト「Chartify」 Instagram大型アップデート「Instagram Stories」をリリース。24時間で消える新しいフィード投稿機能。

Instagram大型アップデート「Instagram Stories」をリリース。24時間で消える新しいフィード投稿機能。 今注目の電子決済アプリ「Origami Pay」を使ってみた。

今注目の電子決済アプリ「Origami Pay」を使ってみた。 にゃんこスターのアンゴラ村長が働いているWebマーケの会社がそれなりにぶっ飛んでた

にゃんこスターのアンゴラ村長が働いているWebマーケの会社がそれなりにぶっ飛んでた 2017年10月版Google Homeに対応しているサービス・アプリ12選

2017年10月版Google Homeに対応しているサービス・アプリ12選